中国/广州 欧盟人工智能法案将于2024年强制执行,为了帮助中国人工智能相关企业提前应对即将到来的国际监管,TÜV南德意志集团(以下简称“TÜV南德”)推出人工智能评估服务:AI质量架构评估方案。本文为Trust AI@TÜV SÜD的系列专栏的第二篇。

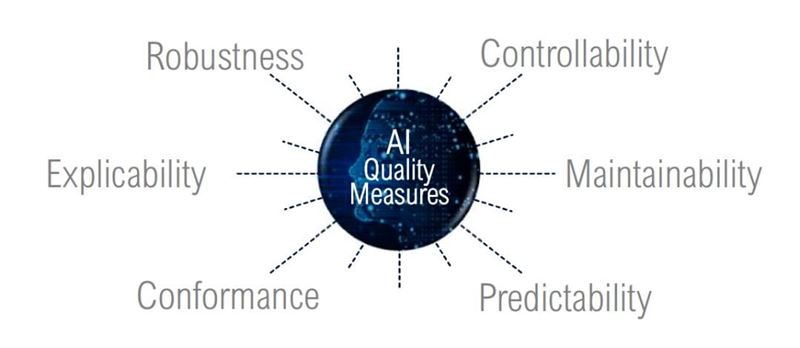

AI质量架构评估方案

2021年4月21日,欧盟委员会发布了欧盟议会和欧盟理事会《关于制定人工智能统一规则》的提案(以下简称“草案”),以面对人工智能应用日益增长所带来的风险及机会。

该草案计划的惩罚力度之高(Article 71),甚至可能高于被称为“史上最严格数据保护立法”的通用数据保护条例(GDPR,欧盟法规编号:(EU) 2016/679):

一、如果人工智能系统存在不可接受风险(Article 5)或违反数据及数据管理要求(Article 10)的情况,处罚高达3000万欧元或6%全球年营业额(以较高者为准);

二、若有违反欧盟人工智能法案中其他要求和义务的情况,处罚高达2000万欧元或4%全球年营业额(以较高者为准);

三、若提供错误、残缺或误导性信息给公告机构或国家主管机关,处罚达1000万欧元或2%全球年营业额(以较高者为准)。

该草案中的人工智能监管框架旨在监督确保市场中的人工智能系统安全运行,并符合现有的人权法律及价值观;确保法规建立以促进人工智能的投资与创新;加强现有法规及安全要求对人工智能系统的治理和有效执行;和促进人工智能市场向合法合规,安全和可信赖的方向积极发展。

该草案将人工智能按其可能产生的风险划分为三类:

在草案中,欧盟针对人工智能的政策提出四种政策选项供利益相关方讨论,并会在正式版本中从四种政策选项中选择,我们将会在下一期栏目中详细为大家详细讲解。

Lingze Meng

Frank Zhu

Site Selector

Global

Asia

Europe

Middle East and Africa